LLM評価

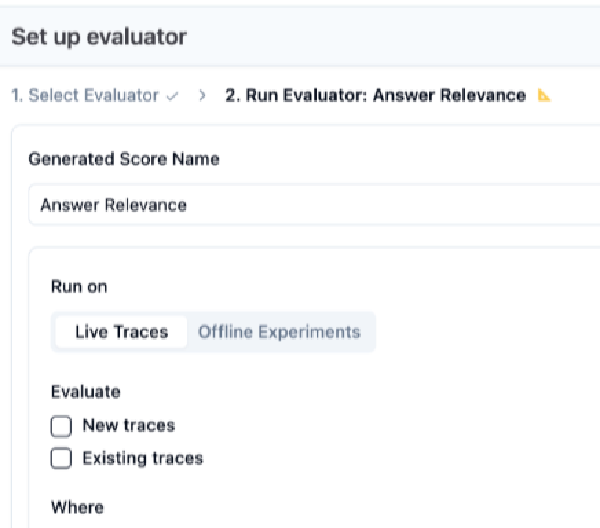

Langfuse の Observation レベル評価:「どのステップが悪いのか」をスコアで特定できるようになった

こんにちは。ガオ株式会社の黒澤です。

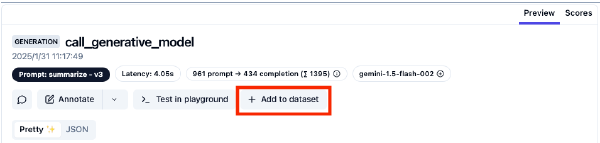

Langfuse v3.153.0 で [PR #11861 ](https://github.com/langfuse/langfuse/pull/11861 ) がマージされ、LLM-as-a-Judge を Observation 単位で実行できるようになりました。本記事ではその背景と使い方をまとめます。

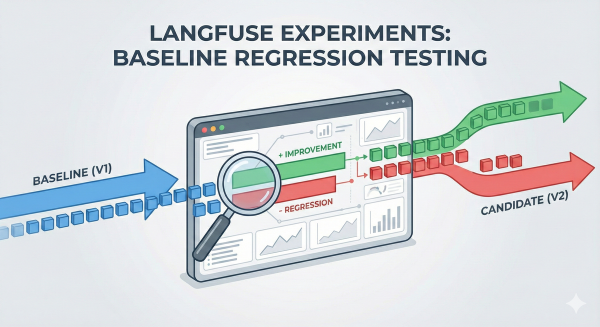

LangfuseのExperiments Compare ViewのBaseline機能を解説

はじめに # LLMアプリケーションの開発において、プロンプトの改善は避けて通れない作業です。しかし、プロンプトを変更するたびに、こんな不安を感じたことはありませんか?

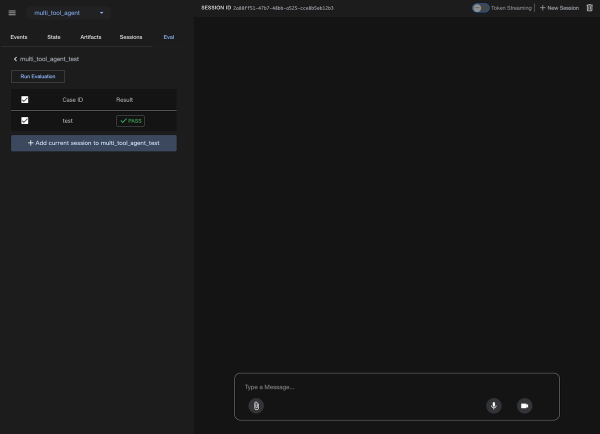

Agent Development Kit (ADK) のエージェント評価を試してみた!

最近話題の Google 製 AI エージェントフレームワーク「Agent Development Kit (ADK)」を触ってみました! Gemini モデルとの連携がしやすく、柔軟なエージェント開発が可能とのことで、期待が高まります。エージェントが自律的にツールを使うのは凄いですが、ちゃんと意図通り動くか、修正で壊れないかを確認する「評価」も重要ですよね。

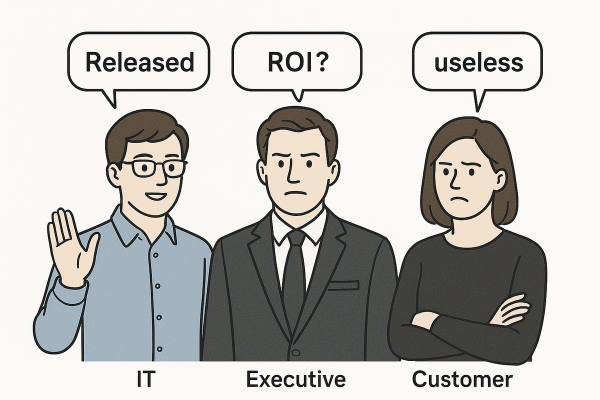

LLMOpsとは? MLOpsとの違いや生成AIの評価について解説

更新日:2025年4月25日

LLMOps とは? # LLMOps(Large Language Model Operations)とは、大規模言語モデル(LLM)を利用した生成AIアプリケーションの開発から運用、改善までを一貫して管理するための考え方や仕組み(フレームワーク)です。多くの企業では、自社でモデルをゼロから構築するのではなく、OpenAI、Google、Anthropic などが提供する基盤モデルを活用し、プロンプト設計やファインチューニング(微調整)を通じて目的に合った生成AIアプリケーションを開発しています。LLMOpsは、こうした開発・運用プロセスを効率化し、品質管理やガバナンスを実現する上で重要な役割を果たします。

Langfuse で LLM 評価を効率化!活用方法徹底解説

更新日:2025年4月10日

1.初めに # 近年、AI 技術、特に大規模言語モデル(LLM)の進化は目覚ましく、様々な分野での活用が進んでいます。しかし、LLM をビジネスに適用する上で、その品質をどのように評価するかが大きな課題となっています。